量子计算会颠覆传统算力吗?答案是肯定的,它将在特定问题上实现指数级加速,但并非万能。

量子计算的本质:从比特到量子比特

传统计算机用0或1的“比特”存储信息,而**量子比特(qubit)**可同时处于0与1的叠加态。

- **叠加原理**:一枚量子比特能同时表示2^n种状态,n越大,并行度越高。

- **纠缠现象**:两枚量子比特一旦纠缠,无论距离多远,测量结果瞬间关联,为并行计算提供天然通道。

- **干涉效应**:通过调控相位,放大正确路径、抵消错误路径,提升算法成功率。

---

量子计算机如何工作:三大核心步骤

1. 初始化:把原子“冻”到基态

实验室里,科学家用激光或电磁场将离子、超导回路或光子冷却到接近绝对零度,**确保量子态纯净**。任何温度扰动都会破坏叠加,因此稀释制冷机成了标配。

2. 操控:用微波“弹钢琴”

微波脉冲相当于琴键,**精确控制量子门的开合**。

- **单量子门**:旋转布洛赫球上的向量,实现任意单比特操作。

- **双量子门**:利用耦合器让两枚量子比特产生受控非门(CNOT),这是构建复杂算法的“砖块”。

3. 读取:把概率变数字

测量时,叠加态坍缩为经典0或1。为了**降低误差**,团队会重复实验数千次,统计概率分布,再反推出计算结果。

---

量子算法为何能“秒杀”经典算法

自问:Shor算法凭什么分解大数这么快?

自答:它把因数分解问题转化为**周期查找**,用量子傅里叶变换在多项式时间内完成,而经典算法需指数时间。

- **Grover搜索**:无序数据库查找速度提升√N倍。

- **量子模拟**:直接模拟分子轨道,新药研发周期或从十年缩至数月。

---

硬件路线之争:谁将胜出?

目前主流四条赛道:

1. **超导量子**:谷歌、IBM领跑,门保真度高,但需极低温。

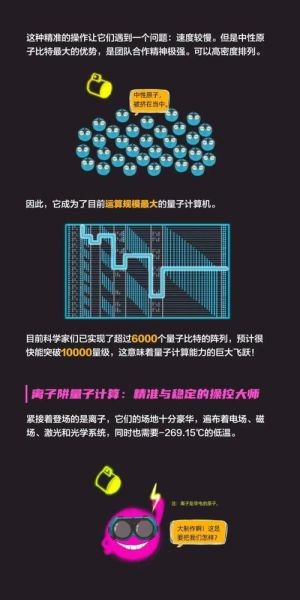

2. **离子阱**:霍尼韦尔方案,相干时间长,却难扩展。

3. **光量子**:室温运行,抗干扰强,可逻辑比特数尚低。

4. **拓扑量子**:微软押注,理论上容错率极高,仍待马约拉纳费米子实证。

个人观点:未来五年,**超导+离子阱混合架构**可能先跑出实用级百量子比特原型机。

---

量子纠错的“魔咒”

没有纠错,量子计算只是玩具。

- **表面码**:用二维网格物理比特编码一个逻辑比特,**阈值约1%**,当前更佳门保真度已逼近。

- **猫态编码**:把信息存进谐振子的相干态,牺牲比特数换稳定。

- **开销估算**:实现一个无错逻辑比特,需要1000个物理比特,这意味着**百万物理比特级**才能跑Shor算法破解RSA-2048。

---

产业落地时间表:别被营销带节奏

- **2025年前**:专用量子模拟器解决材料、金融组合优化问题。

- **2030年左右**:逻辑比特破千,**药物分子全量子模拟**成为可能。

- **2035年后**:若纠错突破,加密体系将被迫升级至**后量子密码**。

---

普通人如何参与这场革命

- **开发者**:学习Qiskit、Cirq框架,在云端真机上跑量子线路。

- **投资者**:关注低温设备、激光系统、微波芯片供应链,而非只盯整机厂。

- **学生**:量子信息科学已成独立学科,**交叉背景**(物理+CS+EE)最吃香。

数据补充:IBM量子 *** 成员已超180家,2023年云端实验时长突破1000万分钟,**真实需求正在萌芽**。

暂时没有评论,来抢沙发吧~